Na niecały miesiąc przed WWDC 2025 Apple oficjalnie zaprezentowało pierwsze funkcje, które trafią do iOS 19 i pozostałych nowych systemów. Są to funkcje dostępności zarówno dla iPhone’a, jak i dla Maca, Apple Watcha czy gogli Vision Pro.

iOS 19 – nowe funkcje dostępności

Nowe funkcje dostępności to m.in. “Accessibility Nutrition Labels“, które zapewnią bardziej szczegółowe informacje o aplikacjach i grach w App Store, nowa aplikacja Lupa dla Maca dla użytkowników niewidomych lub słabowidzących, funkcja Braille Access, pozwalająca robić notatki i wykonywać obliczenia, nowy ogólnosystemowy tryb czytania Accessibility Reader, zaprojektowany z myślą o dostępności, a także aktualizacje funkcji Live Listen, Background Sounds, Personal Voice, Vehicle Motion Cues i innych.

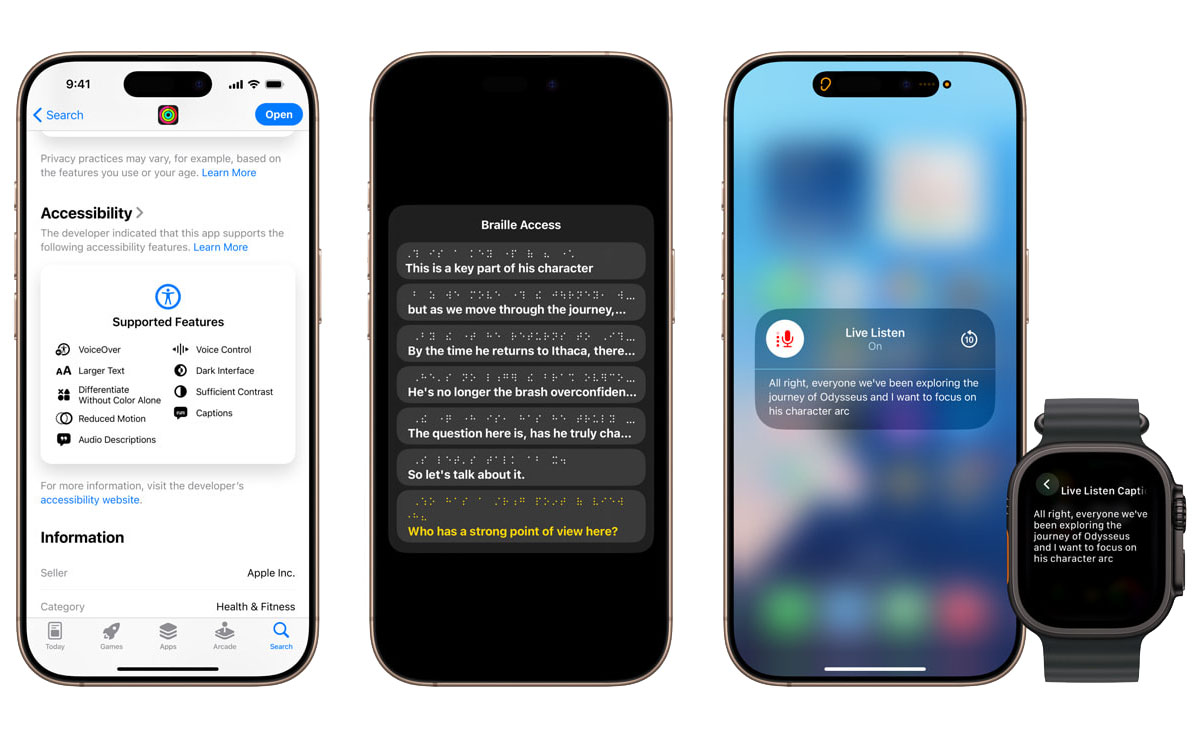

Accessibility Nutrition Labels

Accessibility Nutrition Labels (“Etykiety dostępności”) to nowa sekcja na stronach produktów App Store, która będzie wyróżniać funkcje dostępności w aplikacjach i grach.

Etykiety te pozwolą użytkownikom dowiedzieć się, czy aplikacja będzie dla nich dostępna przed jej pobraniem, a deweloperom dadzą możliwość lepszego informowania i edukowania użytkowników o funkcjach obsługiwanych przez ich aplikację.

Obejmie to VoiceOver, sterowanie głosowe, większy tekst, wystarczający kontrast, ograniczony ruch, napisy i inne.

Lupa dla Maca

Od 2016 r. aplikacja Lupa działa na iPhonie i iPadzie, dając użytkownikom niewidomym lub słabowidzącym narzędzia do powiększania, czytania tekstu i wykrywania obiektów wokół nich.

W tym roku Lupa trafia na komputery Mac. Aplikacja łączy się z kamerą użytkownika, dzięki czemu może on powiększać swoje otoczenie, takie jak ekran lub tablica.

Lupa współpracuje z Continuity Camera na iPhonie, a także z podłączonymi kamerami USB i obsługuje czytanie dokumentów za pomocą Desk View.

Dzięki wielu oknom sesji na żywo, użytkownicy mogą pracować wielozadaniowo, oglądając prezentację za pomocą kamery internetowej i jednocześnie śledząc książkę za pomocą Desk View.

Dzięki niestandardowym widokom użytkownicy mogą dostosować jasność, kontrast, filtry kolorów, a nawet perspektywę, aby tekst i obrazy były łatwiejsze do zobaczenia. Widoki można również przechwytywać, grupować i zapisywać, aby dodać je później.

Ponadto Lupa dla Maca jest zintegrowana z inną nową funkcją ułatwień dostępu, Accessibility Reader, która przekształca tekst ze świata fizycznego w niestandardowy czytelny format.

MacBook Air M4 w świetnej promocji! [SPRAWDŹ]

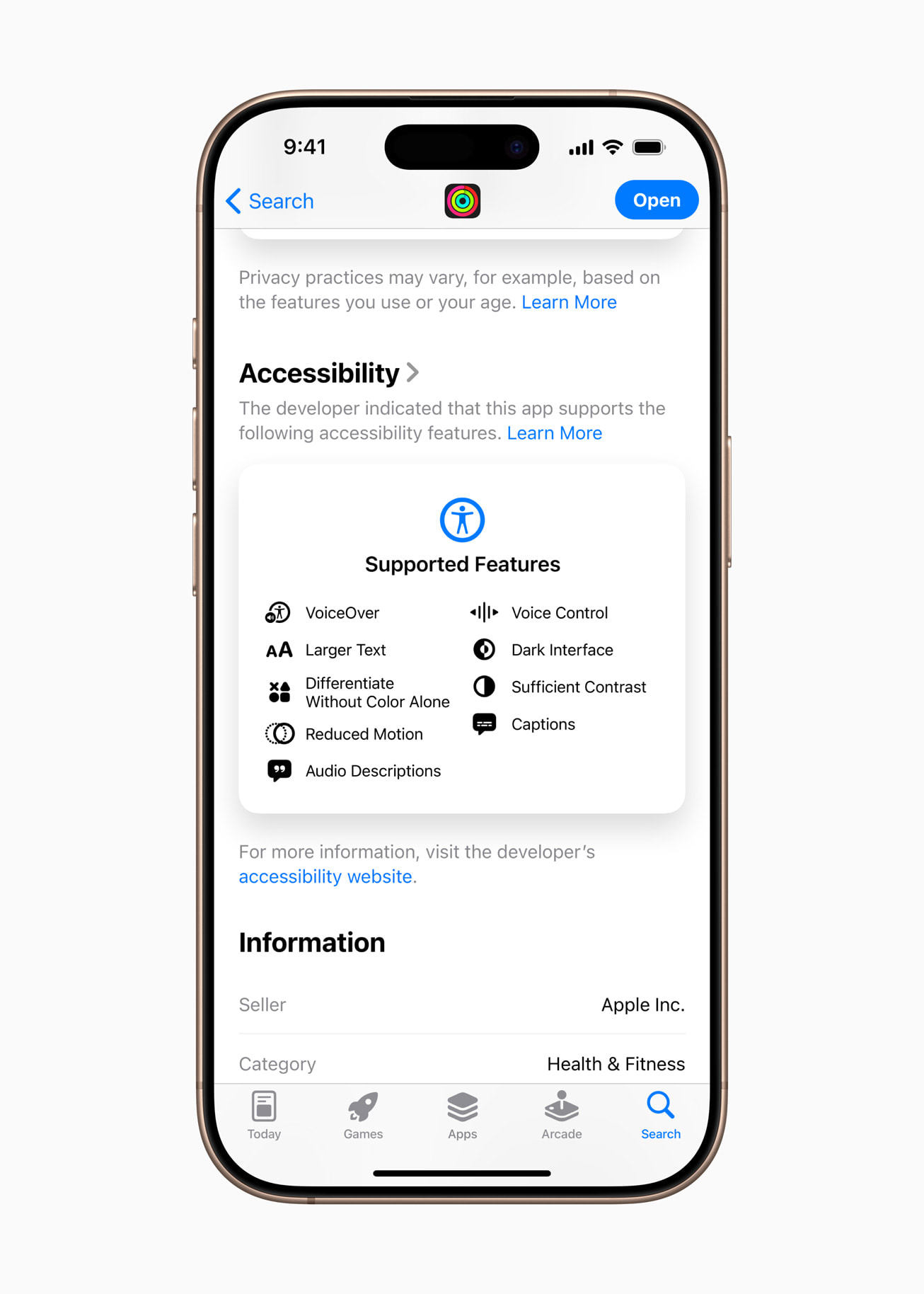

Braille Access

Braille Access to zupełnie nowe rozwiązanie, które zmienia iPhone’a, iPada, Maca i Apple Vision Pro w pełni funkcjonalny notatnik brajlowski, który jest głęboko zintegrowany z ekosystemem Apple.

Dzięki wbudowanemu programowi uruchamiającemu użytkownicy mogą łatwo otworzyć dowolną aplikację, pisząc za pomocą Braille Screen Input lub podłączonego urządzenia brajlowskiego.

Braille Access pozwala szybko sporządzać notatki w formacie brajlowskim i wykonywać obliczenia przy użyciu Nemeth Braille, kodu brajlowskiego często używanego w klasach matematycznych i przyrodniczych.

Użytkownicy mogą otwierać pliki Braille Ready Format (BRF) bezpośrednio z Braille Access, odblokowując szeroką gamę książek i plików utworzonych wcześniej na brajlowskim urządzeniu do robienia notatek. A zintegrowana forma napisów na żywo pozwala użytkownikom na transkrypcję rozmów w czasie rzeczywistym bezpośrednio na wyświetlaczach brajlowskich.

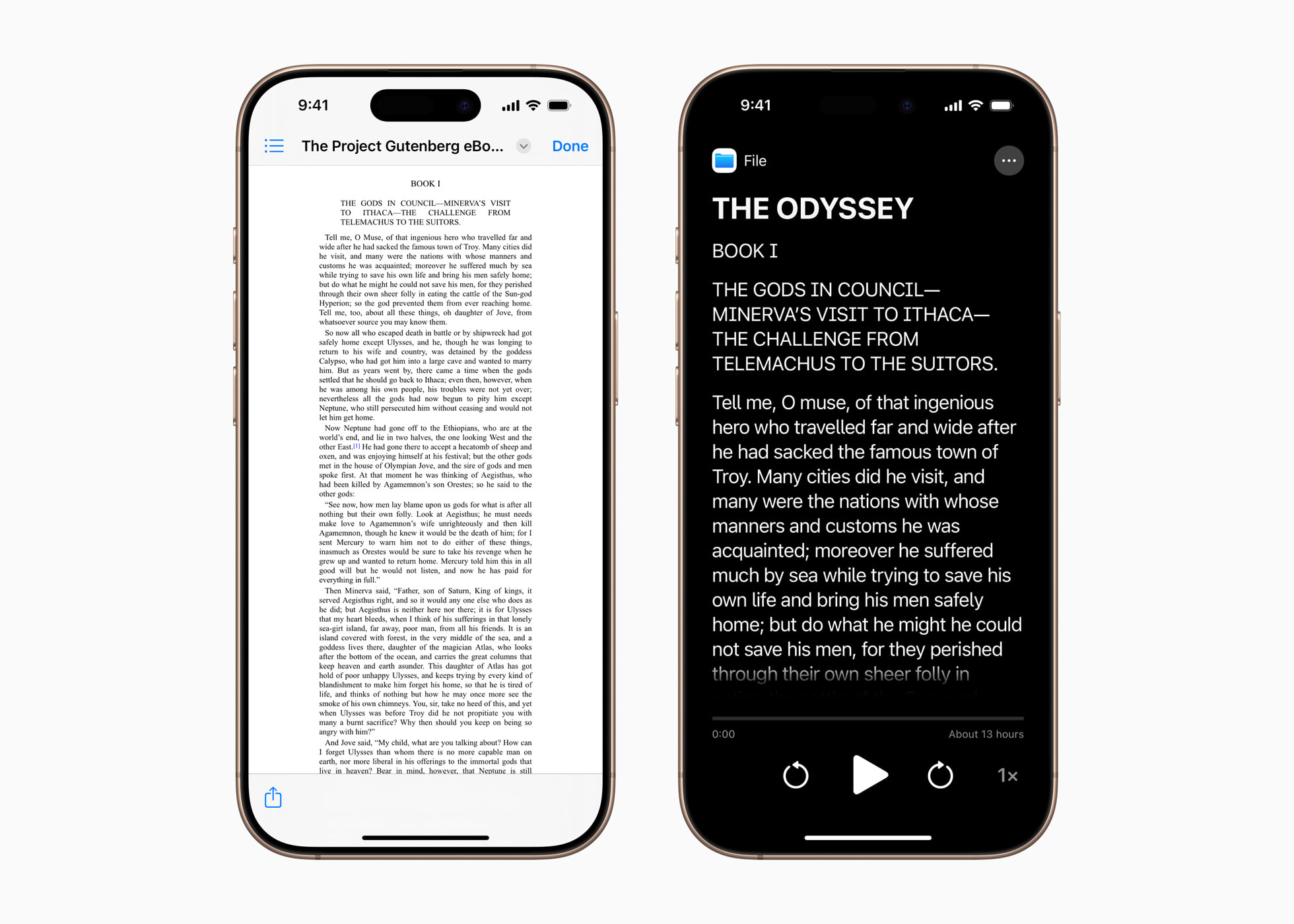

Accessibility Reader

Accessibility Reader to nowy, systemowy tryb czytania, zaprojektowany z myślą o ułatwieniu czytania tekstu użytkownikom z różnymi rodzajami niepełnosprawności, takimi jak dysleksja czy niedowidzenie.

Dostępny na iPhonie, iPadzie, Macu i Apple Vision Pro, Accessibility Reader daje użytkownikom nowe sposoby dostosowywania tekstu i skupiania się na treściach, które chcą przeczytać, z szerokimi opcjami czcionki, koloru i odstępów, a także obsługą treści mówionych.

Accessibility Reader można uruchomić z dowolnej aplikacji i jest on wbudowany w aplikację Lupa dla iOS, iPadOS i macOS, dzięki czemu użytkownicy mogą wchodzić w interakcje z tekstem w świecie rzeczywistym, na przykład w książkach lub w menu restauracji.

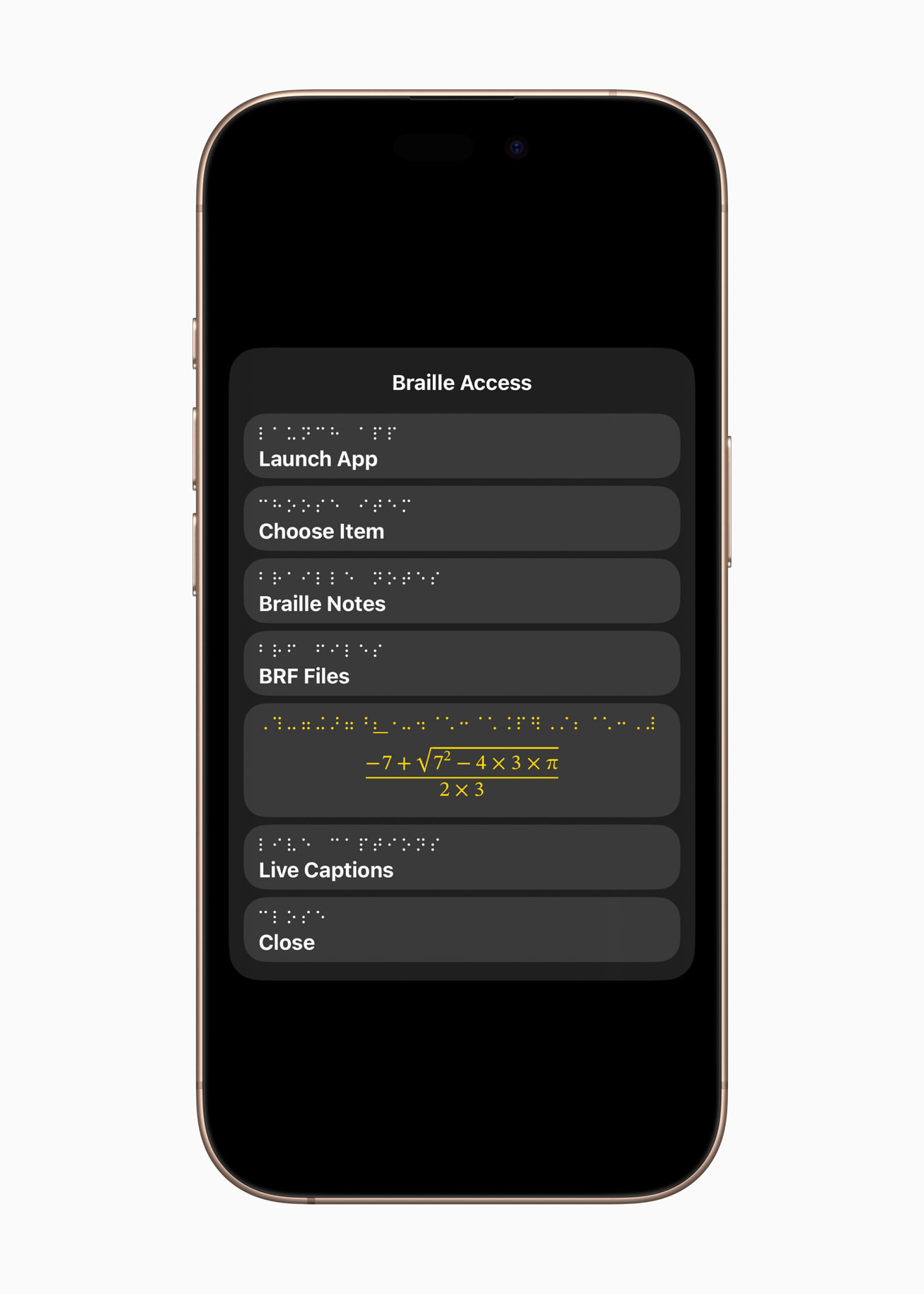

Live Captions na Apple Watchu

Funkcja Live Listen pojawia się na Apple Watch z nowym zestawem funkcji, w tym napisami na żywo w czasie rzeczywistym. Jest przeznaczona dla użytkowników niesłyszących lub niedosłyszących.

Funkcja Live Listen zamienia iPhone’a w zdalny mikrofon do strumieniowania treści bezpośrednio do słuchawek AirPods, aparatów słuchowych Made for iPhone lub słuchawek Beats.

Gdy sesja jest aktywna na iPhonie, użytkownicy mogą wyświetlać napisy na żywo z tego, co słyszy ich iPhone na sparowanym Apple Watch, jednocześnie słuchając dźwięku.

Apple Watch służy jako pilot zdalnego sterowania do rozpoczynania lub zatrzymywania sesji Live Listen lub cofania się do sesji, aby uchwycić coś, co mogło zostać pominięte.

Dzięki Apple Watch sesje Live Listen mogą być kontrolowane z drugiego końca pokoju, więc nie ma potrzeby wstawania w środku spotkania lub podczas zajęć.

Funkcja Live Listen może być używana wraz z funkcjami ochrony słuchu dostępnymi w słuchawkach AirPods Pro 2, w tym z pierwszą w swoim rodzaju funkcją aparatu słuchowego klasy klinicznej.

Prezentacja iOS 19 i nowych wersji pozostałych systemów z Cupertino odbędzie się 9 czerwca na WWDC 2025.