W nowych systemach operacyjnych z Cupertino, czyli z iOS 15, iPadOS 15, watchOS 8 i macOS Monterey, pojawią się trzy nowe mechanizmy, które mają zwiększyć bezpieczeństwo dzieci w sieci i uchronić je przed wykorzystywaniem seksualnym, a także zagrożeniami związanymi z kontaktem z pornografią.

Nowe funkcje ochrony bezpieczeństwa dzieci w systemach operacyjnych Apple

Trzy nowe funkcjonalności zostały oficjalne ogłoszone we wczorajszym komunikacie.

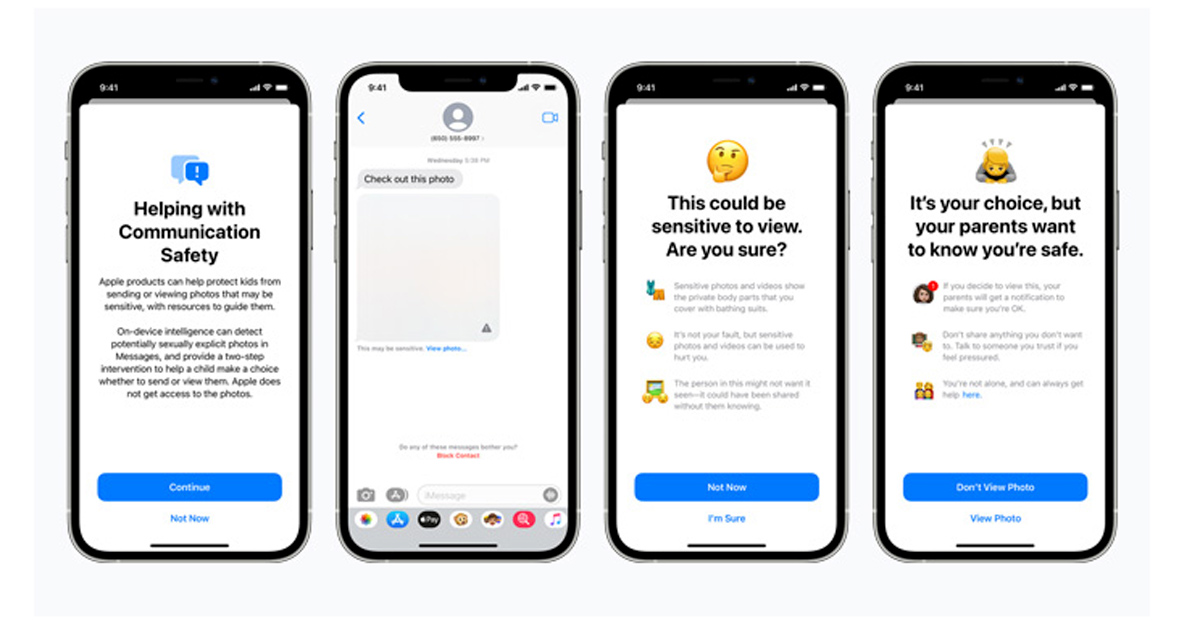

Ochrona komunikacji

Pierwszy z trzech mechanizmów chroniących bezpieczeństwo dzieci został wdrożony do aplikacji Wiadomości. System operacyjny przeprowadzi na urządzeniu analizę wysyłanych lub odbieranych przez iMessage zdjęć.

W przypadku wykrycia pornografii system rozmaże zdjęcie oraz ostrzeże dziecko o tym, że fotografia zawiera nieodpowiednie treści. Jeżeli dziecko będzie nadal próbowało zobaczyć zdjęcie oznaczone jako niewłaściwe, system wyśle powiadomienie do rodziców.

Funkcjonalność będzie działała w systemach iOS 15, iPadOS 15 oraz macOS Monterey, ale do jej działania niezbędne będzie skonfigurowanie w Chmurze rodzinnej danego konta jako konta dziecka.

Skanowanie zdjęć w iCloud pod kątem pornografii dziecięcej

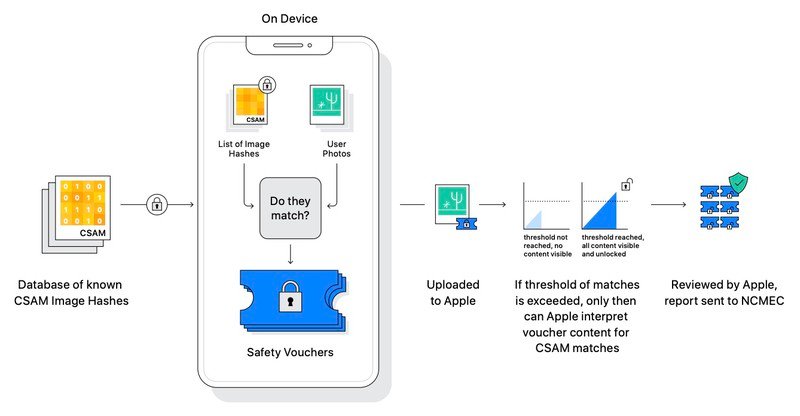

Urządzenia Apple będą skanowały zdjęcia przed ich wysłaniem do bibioteki iCloud w poszukiwaniu pornografii dziecięcej. Aby zachować prywatność użytkowników, cała operacja będzie się odbywała bezpośrednio na urządzeniu i będzie polegała na porównywaniu z biblioteką zdjęć oznaczonych jako dziecięca pornografia, takich organizacji, jak NCMEC (ang. National Center for Missing and Exploited Children).

Co ciekawe, porównywane nie są same zdjęcia, ale opisujące je unikalne hasze, składające się z cyfr i znaków. Takie unikalne hasze dla każdego zdjęcia pozwala wygenerować technologia NeuralHash.

Jeżeli hasz zdjęcia użytkownika wysyłanego do biblioteki iCloud będzie zgodny z haszem z katalogiem znanych zdjęć z pornografią dziecięcą, to wraz z fotografią do biblioteki zostanie przesłany tzw. zaszyfrowany voucher, który – jeżeli przez odpowiednie algorytmy zostanie sklasyfikowany dalej jako pornografia dziecięca – zostanie dalej przesłany do Apple.

Wtedy Apple dokonuje manualnej weryfikacji takiego vouchera i jeżeli podejrzenia się potwierdzą, to zawiesza konto iCloud danego użytkownika i wysyła powiadomienie o całym zajściu do NCMEC.

Rozszerzona pomoc w zgłaszaniu zagrożeń w Siri i Spotlight

Trzecim mechanizmem walki z seksualnym wykorzystywanie nieletnich i pornografią dziecięcą jest rozszerzenie pomocy asystenta głosowego Siri oraz systemowych wyszukiwarek urządzeń Apple w zgłaszaniu tego typu potencjalnie zagrażających dzieciom sytuacji.

Dla przykładu, jeżeli użytkownik wpisze w systemową wyszukiwarkę lub zapyta Siri, jak może zgłosić wykorzystywanie seksualne nieletnich lub pornografię dziecięcą, to w wyniku otrzyma szczegółową instrukcję „krok po kroku” jak to zrobić.

Przypomnę, że powyższe mechanizmy ochrony dzieci i nieletnich zostaną udostępnione publicznie “później w tym roku”, w nadchodzących systemach operacyjnych: iOS 15, iPadOS 15, watchOS 8 oraz macOS Monterey.